The Wall Street Journal ile Stanford Üniversitesi ve Massachusetts Amherst Üniversitesi’ndeki araştırmacıların yaptığı incelemelere göre, Meta Platforms’un sahibi olduğu popüler sosyal medya sitesi Instagram, reşit olmayanlara yönelik cinsel içerik satışı ve ticaretine yönelik geniş bir hesap ağını birbirine bağlamaya ve teşvik etmeye yardımcı oluyor.

Pedofiller uzun zamandır interneti kullanıyor, ancak yasadışı içeriğe ilgi duyan insanlara hitap eden forumlar ve dosya aktarım hizmetlerinin aksine, Instagram bu faaliyetlere yalnızca ev sahipliği yapmıyor, Instagram algoritmaları ayrıca bunları teşvik ediyor. Instagram pedofilleri birbirine bağlıyor ve onları içerik satıcılarına şu yollarla yönlendiriyor. Dergi ve akademik araştırmacılar, niş ilgi alanlarını paylaşan kişileri birbirine bağlama konusunda mükemmel olan öneri sistemleri buldu.

Platformdaki çoğu kişi için gözden uzak olsa da, kötü niyetli kişiler Instagram’daki cinsel içerikli hesaplara ilgileri konusunda küstahça ve yüzsüzce davranıyorlar. Araştırmacılar, Instagram’ın insanların #pedowhore ve #preteensex gibi müstehcen hashtag’leri aramasını sağladığını ve bu terimleri satılık çocuk seks materyallerinin reklamını yapmak için kullanan hesaplara bağladığını tespit etti. Bu tür hesaplar genellikle çocukların kendileri tarafından yönetildiklerini iddia etmekte ve “senin için küçük sürtük” gibi kelimeler içeren açıkça cinsel içerikli başlıklar kullanmaktadır. Yasadışı seks materyalleri satmayı teklif eden Instagram hesapları genellikle bunları açıkça yayınlamıyor, bunun yerine içerik “menüleri” yayınlıyor.

Bazı hesaplar alıcıları belirli eylemleri gerçekleştirmeye davet ediyor. Stanford Üniversitesi’nden araştırmacılar, bazı menülerde çocukların kendilerine zarar verdiği videoların ve “reşit olmayanların hayvanlarla cinsel eylemlerde bulunduğu görüntülerin” fiyatlarının yer aldığını belirtiyor. Doğru fiyata, çocuklar yüz yüze “buluşmaya” hazır.

Reşit olmayanlara yönelik cinsel içeriğin teşviki, Meta tarafından belirlenen kuralların yanı sıra federal yasaları da ihlal etmektedir. Journal’ın sorularına yanıt olarak Meta, uygulama operasyonlarındaki sorunları kabul etti ve gündeme getirilen sorunları ele almak için dahili bir görev gücü kurduğunu söyledi. “Çocuk istismarı korkunç bir suçtur” diyen şirket, “Bu davranışa karşı aktif olarak savunma yapmanın yollarını sürekli araştırıyoruz” diye ekledi.

Meta, son iki yılda 27 pedofili ağını çökerttiğini ve daha fazlasını kaldırmayı planladığını söyledi. Journal’ın sorularını aldığından bu yana platform, bazıları milyonlarca gönderiye sahip olan çocukları cinselleştiren binlerce hashtag’i engellediğini ve sistemlerinin kullanıcılara cinsel istismarla ilişkili olduğu bilinen terimleri aramalarını önermesini kısıtladığını söyledi. Ayrıca sistemlerinin pedofili potansiyeli taşıyan yetişkinlerin birbirleriyle bağlantı kurmasını ya da birbirlerinin içerikleriyle etkileşime girmesini önlemeye çalıştığını söyledi.

Pedofili ve diğer aykırılıklarla ilgili sürdürülen çaba…

Stanford İnternet Gözlemevi’nin başkanı ve Meta’nın 2018’e kadar baş güvenlik sorumlusu olan Alex Stamos, bariz kötüye kullanımın bile kontrol altına alınmasının muhtemelen sürekli bir çaba gerektireceğini söyledi.

“Sınırlı erişimi olan üç akademisyenden oluşan bir ekibin böylesine büyük bir ağı bulabilmesi Meta’da alarm zillerini çaldırmalı” diyen Stamos, şirketin pedofili ağının haritasını çıkarmak için dışarıdan gelenlere kıyasla çok daha etkili araçlara sahip olduğunu belirtti. “Umarım şirket insan araştırmacılarına yeniden yatırım yapar” diye ekledi.

Teknik ve yasal engeller, ağın tam ölçeğinin belirlenmesini Meta dışındaki herhangi bir kişi için kesin olarak ölçmeyi zorlaştırmaktadır. Çocuk seks içeriği ile ilgili yasalar son derece geniş olduğundan, bunun kamuya açık bir platformda açıkça tanıtımını araştırmak bile yasal olarak hassas.

Wall Street Journal, haberinde çevrimiçi çocuk güvenliği konusunda akademik uzmanlara danıştı. Üniversitenin Siber Politika Merkezi’nin sosyal medya istismarına odaklanan bir bölümü olan Stanford İnternet Gözlemevi, kullanıcıların bağlantı kurmasına ve içerik bulmasına yardımcı olan Instagram özelliklerinin bağımsız bir nicel analizini yaptı.

Dergi ayrıca UMass’ın Rescue Lab’ına da başvurarak Instagram’daki pedofillerin daha geniş kapsamlı çevrimiçi çocuk istismarına nasıl uyduğunu değerlendirdi. Her iki kurum da farklı yöntemler kullanarak, suç teşkil eden cinsel istismarı teşvik eden büyük ölçekli toplulukları hızla tespit edebildi.

Büyük ekosistem

Araştırmacılar tarafından kurulan test hesapları, ağdaki tek bir hesabı görüntüledikten hemen sonra, sözde çocuk içeriği satıcıları ve alıcılarının yanı sıra platform dışı içerik ticareti sitelerine bağlanan hesapların “sizin için önerilen” önerileriyle karşılaştı. Bu tavsiyelerden sadece birkaçına uymak, bir test hesabını çocukları cinselleştiren içerikle doldurmak için yeterliydi.

Stanford İnternet Gözlemevi, reşit olmayanlarla seksle ilgili hashtag’leri kullanarak, araştırmacıların “kendi ürettikleri” çocuk seks materyali olarak adlandırdıkları 405 satıcıyı -ya da bazıları 12 yaşından küçük olduklarını söyleyen çocukların kendileri tarafından yönetildiği iddia edilen hesapları- buldu. Bir ağ haritalama yazılımı olan Maltego aracılığıyla toplanan verilere göre, bu satıcı hesaplardan 112’sinin toplu olarak 22.000 tekil takipçisi vardı.

Küçük yaşta cinsel içerik oluşturanlar ve satın alanlar, cinselleştirilmiş çocuk içeriğine adanmış daha büyük bir ekosistemin sadece bir köşesidir. Instagram’daki pedofili topluluğundaki diğer hesaplar pedofili yanlısı memeleri (İnternet fenomeni, internet geyiği anlamaında gelen İnternet Memes, İnternet üzerinde anonim olarak genellikle popüler resim, video, kelime ya da cümleler şeklinde yayılan ve geniş kitlelerce manası bilinen olgulara verilen isimdir.) bir araya getiriyor veya çocuklara erişimlerini tartışıyor.

Instagram çocuk güvenliği girişimleri üzerinde çalışmış olan mevcut ve eski Meta çalışanları, öncelikle bu tür içerikleri takip etmek için var olan hesapların sayısının yüz binlerle ifade edildiğini tahmin etmektedir, milyonlar değil. Bir Meta sözcüsü, şirketin aktif olarak bu tür kullanıcıları kaldırmaya çalıştığını ve yalnızca Ocak ayında çocuk güvenliği politikalarını ihlal ettiği için 490.000 hesabı kapattığını söyledi.

Çevrimiçi çocuk mağduriyetini araştıran ve bununla mücadele etmek için adli tıp araçları geliştiren UMass Rescue Lab’in yöneticisi Brian Levine, “Instagram, internette daha açık çocuk cinsel istismarının olduğu yerlere giden bir rampa” dedi. Levine, Adalet Bakanlığı’nın araştırma kolu olan Ulusal Adalet Enstitüsü için internette çocuk istismarı üzerine 2022 tarihli bir raporun yazarıdır.

1,3 milyardan fazla kullanıcıya sahip olduğu tahmin edilen Instagram, özellikle gençler arasında popüler. Stanford araştırmacıları, diğer, daha küçük sosyal platformlarda benzer cinsel istismar faaliyetleri buldular, ancak sorunun özellikle Instagram’da ciddi olduğunu bulduğunu söylediler. 7 Haziran’da yayınlanacak bir raporda, “Bu alıcı ve satıcı ağları için en önemli platform Instagram gibi görünüyor” diye yazdılar. Instagram, dahili istatistiklerinin, kullanıcıların görüntülenen 10 bin gönderiden birinden daha azında çocuk istismarı gördüğünü gösterdiğini söyledi.

Onaylanmış resimler

Sosyal medya platformları ve kolluk kuvvetlerinin çevrimiçi çocuk pornografisinin yayılmasıyla mücadele etme çabaları, büyük ölçüde, zaten dolaşımda olduğu bilinen, çocukların cinsel istismarı materyali veya CSAM olarak bilinen, doğrulanmış resim ve videoların aranmasına odaklanır. Ulusal Kayıp ve İstismara Uğrayan Çocuklar Merkezi, kolluk kuvvetleriyle birlikte çalışan, kar amacı gütmeyen bir ABD kuruluşu, bu tür resim ve videolar için bir dijital parmak izi veri tabanı ve bu tür verileri internet şirketleri arasında paylaşmak için bir platform bulundurur.

İnternet şirketi algoritmaları, platformlarında yayınlanan görüntülerin dijital parmak izlerini bu listeye göre kontrol eder ve ABD federal yasalarının gerektirdiği şekilde, bunları tespit ettiklerinde merkeze geri rapor verir. 2022’de merkez, çoğu internet şirketlerinden olmak üzere 31,9 milyon çocuk pornografisi raporu aldı ve bu rakam iki yıl öncesine göre %47 arttı.

Instagram, Facebook ve WhatsApp dahil olmak üzere uygulamalarında 3 milyardan fazla kullanıcıya sahip olan Meta, şifrelenmemişlerse bu tür bilinen görüntüleri tespit edebiliyor. Merkeze gönderilen çocuk pornografisi raporlarının %85’ini Meta oluşturuyor ve yaklaşık 5 milyonu Instagram’dan geliyor.

Meta’nın mevcut çocuk istismarı içeriğine yönelik otomatik taraması, yeni görselleri veya bunların satışının reklamını yapmaya yönelik çabaları tespit edemez. Stanford araştırmacılarının yanı sıra mevcut ve eski çalışanlar, bu tür etkinliklerin önlenmesi ve tespit edilmesinin yalnızca kullanıcı raporlarını incelemeyi değil, pedofil ağlarını izlemeyi ve bozmayı gerektirdiğini söylüyor. Amaç, bu tür kullanıcıların birbirleriyle bağlantı kurmasını, içerik bulmasını ve kurban bulmasını zorlaştırmaktır.

UMass’tan Levine, bu tür çalışmaların hayati önem taşıdığını çünkü kolluk kuvvetlerinin NCMEC’in aldığı ipuçlarının çok küçük bir kısmından fazlasını araştıracak kaynaklardan yoksun olduğunu söyledi. Bu, platformların bir topluluğun çocuk cinsel istismarını oluşturmasını ve normalleştirmesini önlemek için birincil sorumluluğa sahip olduğu anlamına gelir.

Tasarım özellikleri

Stanford, Meta’nın hem yasal hem de yasa dışı materyallerin içerik keşfini teşvik eden zayıf uygulama ve tasarım özellikleri nedeniyle bu çabalarla diğer platformlardan daha fazla mücadele ettiğini buldu. Stanford ekibi, Twitter’da çocuklara yönelik cinsel istismar materyali satmayı teklif eden 128 hesap buldu; bu, Twitter’dan çok daha geniş bir genel kullanıcı tabanına sahip olan Instagram’da buldukları sayının üçte birinden daha az. Ekip, Twitter’ın bu tür hesapları Instagram kadar önermediğini ve çok daha hızlı bir şekilde kapattığını buldu.

Gençler arasında popüler olan diğer platformlar arasında Snapchat, esas olarak doğrudan mesajlaşma için kullanılır, bu nedenle ağ oluşturmaya yardımcı olmaz. Stanford raporu, TikTok’un platformunun “bu tür içeriğin çoğalmadığı” bir platform olduğunu söyledi.

Meta, çocukları istismar eden ağları devre dışı bırakmak için harekete geçtiğini söyledi.

Instagram, temel bir teknolojiyi denetlemekte zorlandı: anahtar kelimeler. Hashtag’ler Instagram’da içerik keşfinin merkezi bir parçasıdır ve kullanıcıların #moda veya #nba gibi geniş konulardan #embroidery veya #spelunking gibi daha dar konulara kadar belirli bir topluluğu ilgilendiren gönderileri etiketleyip bulmasına olanak tanır.

Pedofillerin de kendi seçtikleri hashtag’leri vardır. Akademik araştırmacılar, #pedobait gibi arama terimleri ve #mnsfw’nin (“küçük iş için güvenli değil”) varyasyonlarının, çocukların yer aldığı seks içeriğinin reklamını yapmaya adanmış binlerce gönderiyi etiketlemek için kullanıldığını ve bu gönderilerin alıcılar tarafından kolayca bulunabilmesini sağladığını keşfetti. Journal’dan gelen sorguların ardından Meta, bu tür terimleri yasaklama sürecinde olduğunu söyledi.

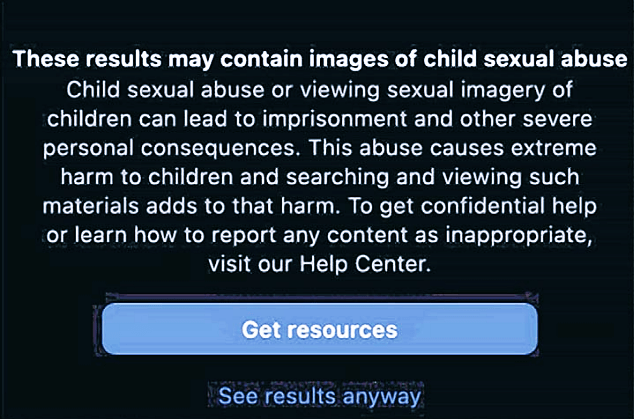

Çoğu durumda Instagram, kullanıcıların kendi algoritmalarının yasadışı materyallerle ilişkilendirilebileceğini bildiği terimleri aramasına izin verdi. Bu gibi durumlarda kullanıcılara açılan bir ekranda “Bu sonuçlar çocuk cinsel istismarı görüntüleri içerebilir” uyarısında bulunularak, bu tür materyallerin üretilmesinin ve tüketilmesinin çocuklara “aşırı zarar” verdiğine dikkat çekildi. Ekran, kullanıcılara iki seçenek sunuyordu: “Kaynak al” ve “Yine de sonuçları gör.”

Journal’dan gelen sorulara yanıt olarak Instagram, kullanıcıların yasa dışı görüntüler üretme olasılığı bulunan terimler için arama sonuçlarını görüntüleme seçeneğini kaldırdı. Şirket, seçeneği neden sunduğunu söylemeyi reddetti.

Araştırmacılar, Instagram’daki pedofilik hesapların, faaliyetlerini gizlemek için yüzsüzlükle yüzeysel çabaları karıştırdığını buldu. UMass’tan Levine’e göre, belirli emojiler bir tür kod işlevi görür; örneğin, bir haritanın görüntüsü -“küçük çekici kişi”nin kısaltması- veya baş harflerini “çocuk pornografisi” ile paylaşan “peynirli pizza” gibi. Birçoğu kendilerini “hayattaki küçük şeyleri seven” ilan ediyor.

UMass’tan Levine, hesaplardan bazılarının seks kaçakçılığı belirtileri taşıdığını söyledi, örneğin bir gencin yüzüne WHORE karalanmış olarak gösterilmesi gibi. Instagram’ın sübyancı topluluğundaki bir hesapla kısa bir temas bile, platformun kullanıcılara katılmalarını önermeye başlamasını tetikleyebilir. Kanadalı iki çocuk annesi Sarah Adams, çocuk istismarı ve sosyal medyada aşırı paylaşımın tehlikelerini tartışan bir Instagram kitlesi oluşturdu. Bu konuya odaklandığı için Adams’ın takipçileri bazen ona platformda karşılaştıkları rahatsız edici şeyleri gönderiyor. Şubat ayında bir takipçisinin kendisine “ensest çocuklar” ifadesini kullanan bir hesapla mesaj attığını söyledi.

Adams, 10.000’den fazla takipçisi olan ensest yanlısı meme paylaşımlardan oluşan bir koleksiyon olan hesaba yalnızca birkaç saniye erişip Instagram’a şikayet ettiğini ve ardından unutmaya çalıştığını söyledi. Ancak sonraki birkaç gün içinde, dehşete kapılmış ebeveynlerden haber almaya başladı. Adams’ın Instagram profiline baktıklarında, Adams’ın hesapla teması nedeniyle kendilerine “ensest bebekler” önerildiğini söyledi.

Bir Meta sözcüsü, “ensest bebeklerin” kurallarını ihlal ettiğini ve Instagram’ın uygulamada hata yaptığını söyledi. Şirket, bu tür uygunsuz tavsiyeleri yeni çocuk güvenliği görev gücünün bir parçası olarak ele almayı planladığını söyledi. Diğer platformlar gibi Instagram da kullanıcılarını kuralları çiğneyen hesapları tespit etmeye yardımcı olmaya çağırıyor. Ancak bu çabalar her zaman etkili olmamıştır.

Instagram tarafından cevaplanmamış raporlar ve bildirimler

Bir hatayı düzeltme

Bir Meta sözcüsü, Meta’nın raporları aldığını ve bunlara göre hareket etmediğini kabul etti. Sözcü, şirketin çocuklara yönelik cinsel istismar raporlarını nasıl ele aldığına ilişkin bir incelemede, bir yazılım arızasının kullanıcı raporlarının önemli bir kısmının işlenmesini engellediğini ve şirketin denetim ekibinin platformun kurallarını gerektiği gibi uygulamadığını söyledi.

Şirket, raporlama sistemindeki hatayı o zamandan beri düzelttiğini ve içerik moderatörlerine yeni eğitimler verdiğini söyledi. Şirketin Stanford ve Journal tarafından dikkatine sunulan ilk hesap taramasının ardından UMass’tan Levine, Instagram’da kalan reşit olmayan satıcı hesaplarından bazılarını kontrol etti. Daha önce olduğu gibi, bunlardan birini bile görüntülemek, Instagram’ın yenilerini önermesine neden oldu. Instagram’ın önerileri, platformun kendi güvenlik ekibinin dağıtmaya çalıştığı ağı yeniden inşa etmeye yardımcı oluyordu.

Bir Meta sözcüsü, bu tür tavsiyeleri önleyecek sistemlerinin şu anda inşa edildiğini söyledi. Levine, Instagram’ın pedofilik içeriği ve hesapları teşvik etmedeki rolünü kabul edilemez olarak nitelendirdi. Acil durum frenini çekin, dedi. “Ekonomik faydalar bu çocuklara verilen zararlara değer mi?”

Yukarıdaki bu haber metni Wall Street Journal adlı gazetenin ana sayfasında 8 Haziran 2023’teki baskısında ana sayfada girizgah ile gösterilip 10. sayfasında geniş yer ayrılarak anlatılmıştır. Instagram ve daha birçok küreselci medyanın Covid döneminde nasıl sansürleme yaptığını hatırlıyorsunuz değil mi? Onlara gelişmiş sansür otomasyonunu devreye sokanlar, Pedofili konusunda neden bu kadar gevşek davranıyor?

Çünkü LGBT+Q denilen türlü sapkınlıklara doğrudan destek veriyorlar. ABD bile artık LGBT+Q devleti olduğunu resmen ilan eder noktaya geldi. Covid döneminde ortaya çıkan Pizzagate skandalı, Jeffrey Eppstein’ın sapkınlık adası ve daha türlü rezillikler artık biliniyor. Yukarıdaki resme tıklayarak LGBT+Q yazımızı okuyabilir ve bu konu hakkında detaylı bilgiye sahip olabilirsiniz.

Faydalanılan kaynak: https://www.wsj.com/articles/instagram-vast-pedophile-network-4ab7189